Lokální provoz LLM už dávno není jen hračka pro experimenty. Firmy řeší interní chatboty, API pro aplikace, automatizaci podpory i dávkové zpracování textu. V takové chvíli ale nestačí vědět, jak rychle model odpoví jednomu uživateli. Důležité je, co se stane ve chvíli, kdy začne model obsluhovat 8, 16 nebo 32 aktivních uživatelů současně.

Právě zde je největší rozdíl mezi řešením, které je příjemné na první spuštění, a řešením, které zvládne reálnou produkční zátěž. Ollama je výborná pro rychlý lokální start, zatímco vLLM je navržené jako inference engine pro vysoký výkon a škálování.

Ollama je jednoduchý runtime pro lokální spouštění modelů. Silnou stránkou je rychlé nasazení, připravené modely a možnost provozu i na slabším hardwaru nebo pouze na CPU. Pokud si chcete model rychle vyzkoušet, udělat interní prototyp nebo lokální experiment, je to velmi pohodlná cesta.

vLLM naopak cílí na situace, kde rozhoduje throughput, nízká latence a obsluha většího množství požadavků. Nejde jen o to, že odpověď přijde rychleji. Ještě důležitější je, že se výkon při více uživatelích nerozpadá tak rychle jako u jednodušších runtime řešení.

Rozdíl ve filozofii je tedy jasný: Ollama = jednoduchost a flexibilita, vLLM = maximální využití GPU pro API a produkci.

Všechny testy proběhly na stejném systému s NVIDIA RTX PRO 6000 Blackwell a 96 GB VRAM. Díky tomu porovnáváme chování obou řešení na identickém hardwaru bez vlivu rozdílné konfigurace. Testovali jsme stejné modely, stejný limit MAX_TOKENS = 2000 a stejnou zátěž v podobě 1, 2, 4, 8, 16 a 32 aktivních uživatelů současně.

U Ollamy jsme při testování nastavili pouze 10000 tokenů contextu, aby se všechny modely bezpečně vešly do paměti i při větším počtu paralelních požadavků. vLLM tento problém řeší výrazně elegantněji, protože používá dynamickou alokaci KV cache podle aktuálních potřeb konkrétního requestu.

Jinými slovy: benchmark neukazuje jen hrubou rychlost jednoho modelu, ale i to, jak efektivně obě řešení pracují s dostupnou pamětí a jak dobře si poradí s růstem zátěže na jednom GPU.

Benchmark běžel na jednom dlouhém testovacím promptu, který měl model donutit generovat souvislou a dostatečně dlouhou odpověď. Prompt byl navržený tak, aby vyžadoval minimálně 3000 tokenů výstupu, byl rozdělený do 10 sekcí a nutil model pokračovat bez předčasného ukončení.

You are in a benchmarking environment. Your goal is to generate a LONG, CONTINUOUS response of at least 3000 tokens.

Do NOT stop early. Do NOT summarize. Do NOT conclude until the minimum length is reached.

Write a highly detailed, exhaustive explanation of Artificial Intelligence.

STRICT RULES:

- The response MUST be at least 3000 tokens long.

- Divide the response into at least 10 sections.

- Each section must be at least 200–300 words.

- If you finish a section, immediately continue to the next.

- Do not produce a conclusion until the total length exceeds 3000 tokens.

- If you are about to stop, continue expanding with more detail, examples, and subtopics.

STRUCTURE:

1. Definition and history

2. Types of AI (narrow, general, superintelligence)

3. Machine learning foundations

4. Neural networks in depth

5. Training processes and optimization

6. Data and feature engineering

7. Real-world applications across industries

8. Limitations and challenges

9. Ethical considerations

10. Future of AI

IMPORTANT:

If the output is cut off due to limits, continue exactly where you left off when prompted.

Begin now.Počet tokenů v promptu jsme počítali pomocí jednoduché aproximace max(1, len(text) // 4). Implementovat samostatný tokenizer pro každý model by bylo při porovnání více různých modelů zbytečně složité a nepraktické. Pro účely benchmarku je tato aproximace bezproblémová, protože na všechny testované modely byla použita úplně stejná metoda výpočtu, takže srovnání zůstává férové.

V praxi to znamená, že jeden token jsme přibližně odhadovali jako čtyři znaky textu. Není to přesný tokenizer konkrétního modelu, ale pro porovnání více systémů nad stejným zadáním je tato matematická zkratka dostatečně konzistentní a dobře použitelná.

Ještě před začátkem každého měření proběhl také warmup. Každý model nejprve vygeneroval WARMUP_TOKENS = 500 tokenů a teprve bezprostředně poté začal samotný benchmark. Díky tomu jsou výsledky konzistentnější a méně zkreslené prvotní inicializací modelu nebo prostředí.

Pro úplnost je dobré doplnit i konkrétní varianty modelů a kvantizací. V případě GPT OSS 120B jsme u vLLM použili openai/gpt-oss-120b ve variantě MXFP4, zatímco v Ollamě běžel model gpt-oss:120b s kvantizací Q4_K_M. Pro Gemma 3 27B jsme u vLLM testovali gaunernst/gemma-3-27b-it-int4-awq s kvantizací int4-awq, zatímco v Ollamě běžel gemma3:27b opět s kvantizací Q4_K_M.

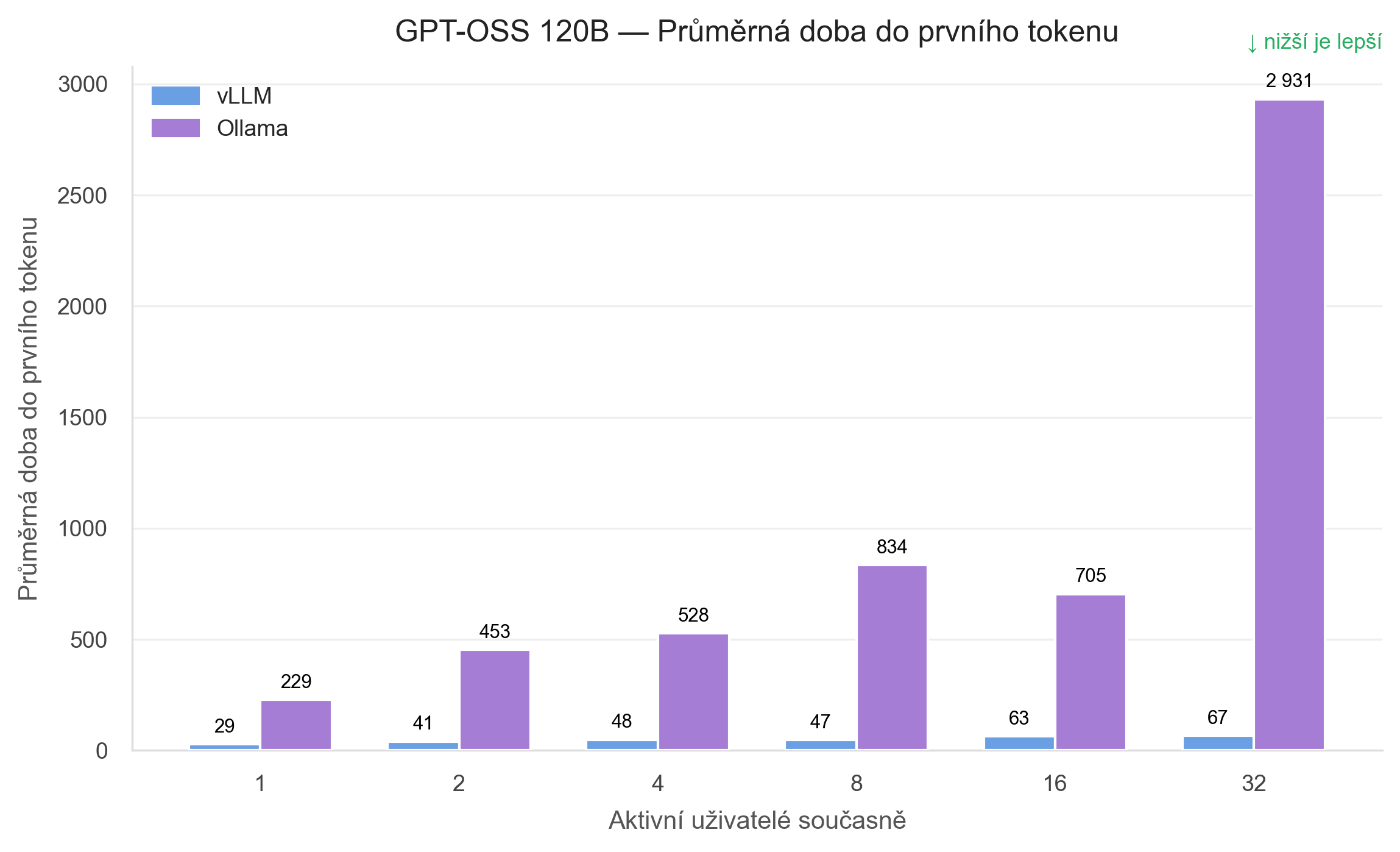

První srovnání patří modelu GPT OSS 120B. Jde o dostatečně velký model na to, aby se rozdíly v práci s GPU, plánování požadavků i latenci projevily velmi výrazně. Právě zde je nejlépe vidět, že mezi jednoduchým lokálním runtime a produkčně orientovaným enginem existuje zásadní rozdíl.

TTFT je jedna z nejdůležitějších metrik pro reálný uživatelský dojem. Pokud je vysoká, uživatel má pocit, že systém dlouho čeká, i když následné generování může být rychlé.

U vLLM se TTFT drží i při růstu zátěže velmi nízko. Při jednom aktivním uživateli jsme naměřili přibližně 29 ms, při 16 uživatelích 63 ms a dokonce i při 32 uživatelích jen 67 ms. To je stále odezva, která v API provozu působí svižně.

Ollama začíná už při jednom uživateli na 229 ms, při 8 uživatelích je na 834 ms a při 32 uživatelích stoupá na 2 931 ms. V praxi to znamená, že zatímco vLLM stále reaguje téměř okamžitě, Ollama už při vyšší zátěži působí jako služba, která před odpovědí dlouho čeká.

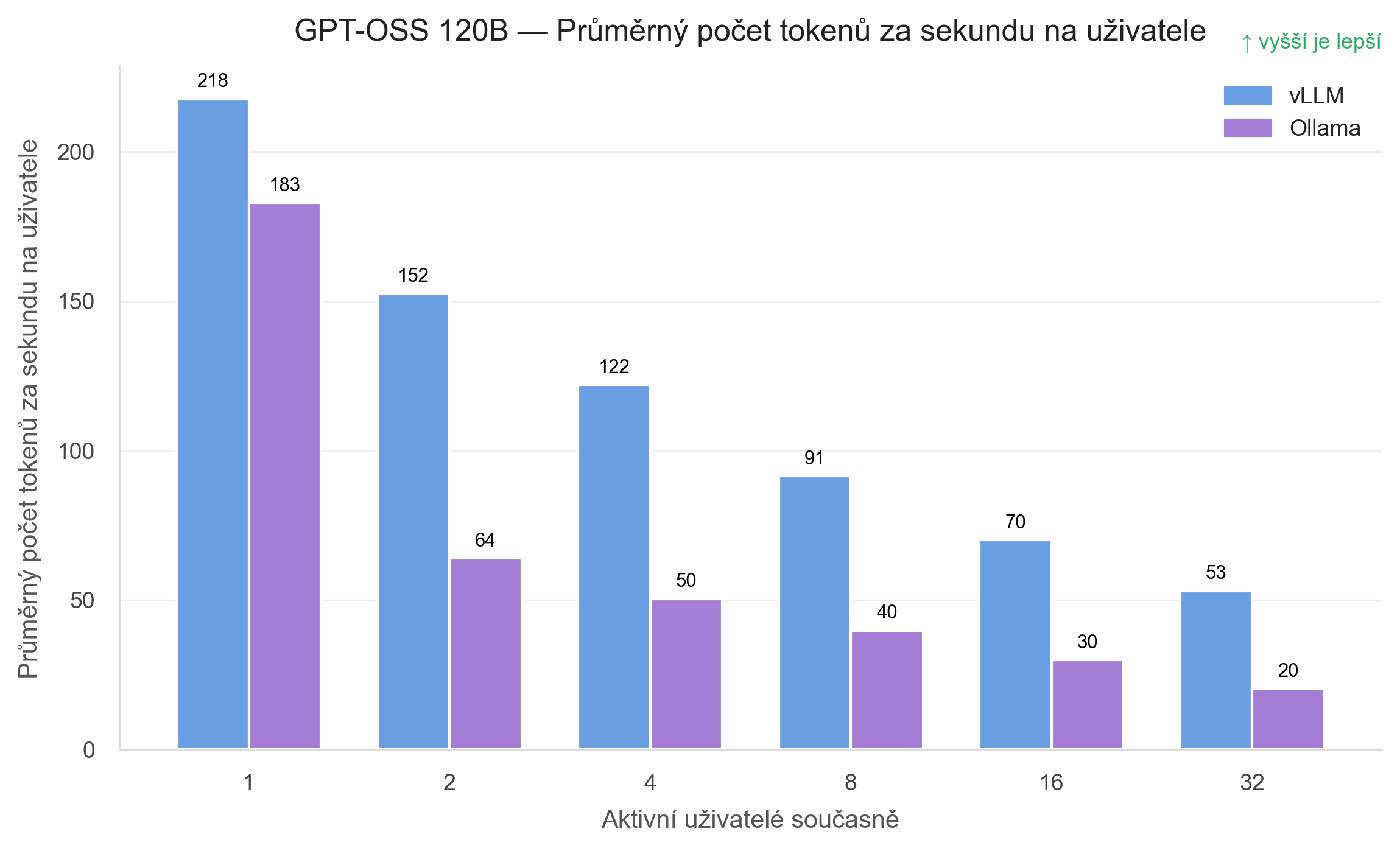

Metrika TPS na uživatele ukazuje, jak se mění kvalita obsluhy jednotlivých requestů se zvyšující se zátěží.

vLLM sice s růstem počtu uživatelů logicky ztrácí část výkonu na jednoho klienta, ale zbylý výkon na jednoho klienta zůstává stále dobře využitelný. Z přibližně 218 tokenů za sekundu při jednom uživateli se dostává na 53 tokenů za sekundu při 32 uživatelích. To je pořád hodnota, se kterou lze provozovat svižné API.

Ollama naopak klesá z 183 tokenů za sekundu na pouhých 20 tokenů za sekundu při 32 aktivních uživatelích. Rozdíl je tedy znatelný nejen na celkové průchodnosti, ale i na tom, jak rychle se generuje odpověď pro každého jednotlivého klienta.

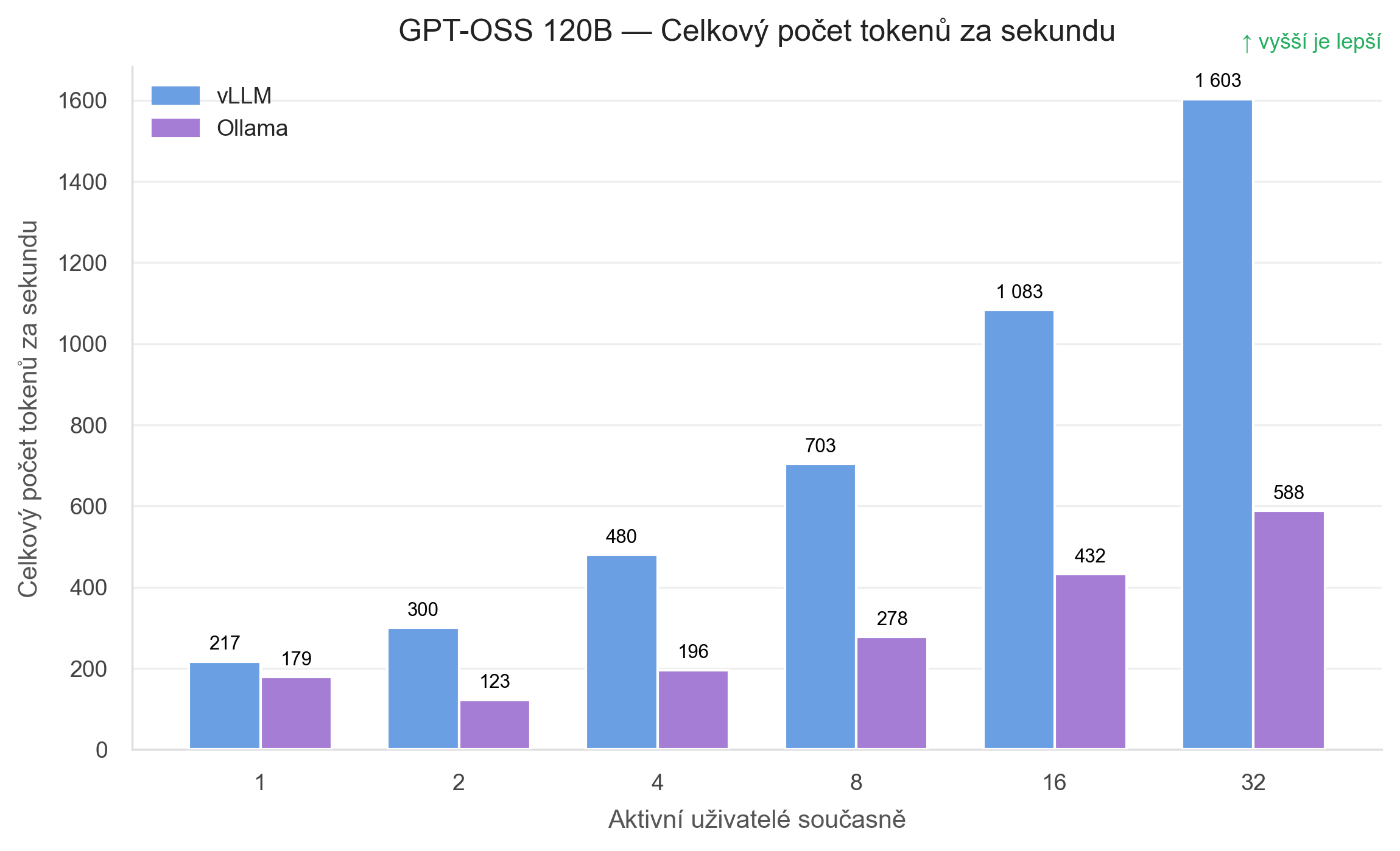

Celkový overall throughput nejlépe ukazuje, jak dobře je využité GPU jako celek.

U vLLM roste celkový výkon velmi přesvědčivě: z přibližně 217 TPS při jednom uživateli až na 1 603 TPS při 32 uživatelích. To znamená, že GPU je zatěžované efektivně a systém dokáže paralelní požadavky skládat dohromady tak, aby z dostupného výkonu vytěžil maximum.

Ollama se z 179 TPS dostane jen na 588 TPS. Jinými slovy, při 32 aktivních uživatelích dává vLLM zhruba 2,7× vyšší celkový výkon. Pro produkční API je to rozdíl, který se promítne do ceny za jeden obsloužený request i do počtu uživatelů, které zvládnete obsloužit na jednom GPU.

Otestujte výkon NVIDIA RTX PRO 6000 Blackwell pro vLLM, firemní AI API i více uživatelů současně.

Bez investice do vlastního hardwaru si ověříte, kolik výkonu skutečně dostanete z jednoho GPU.

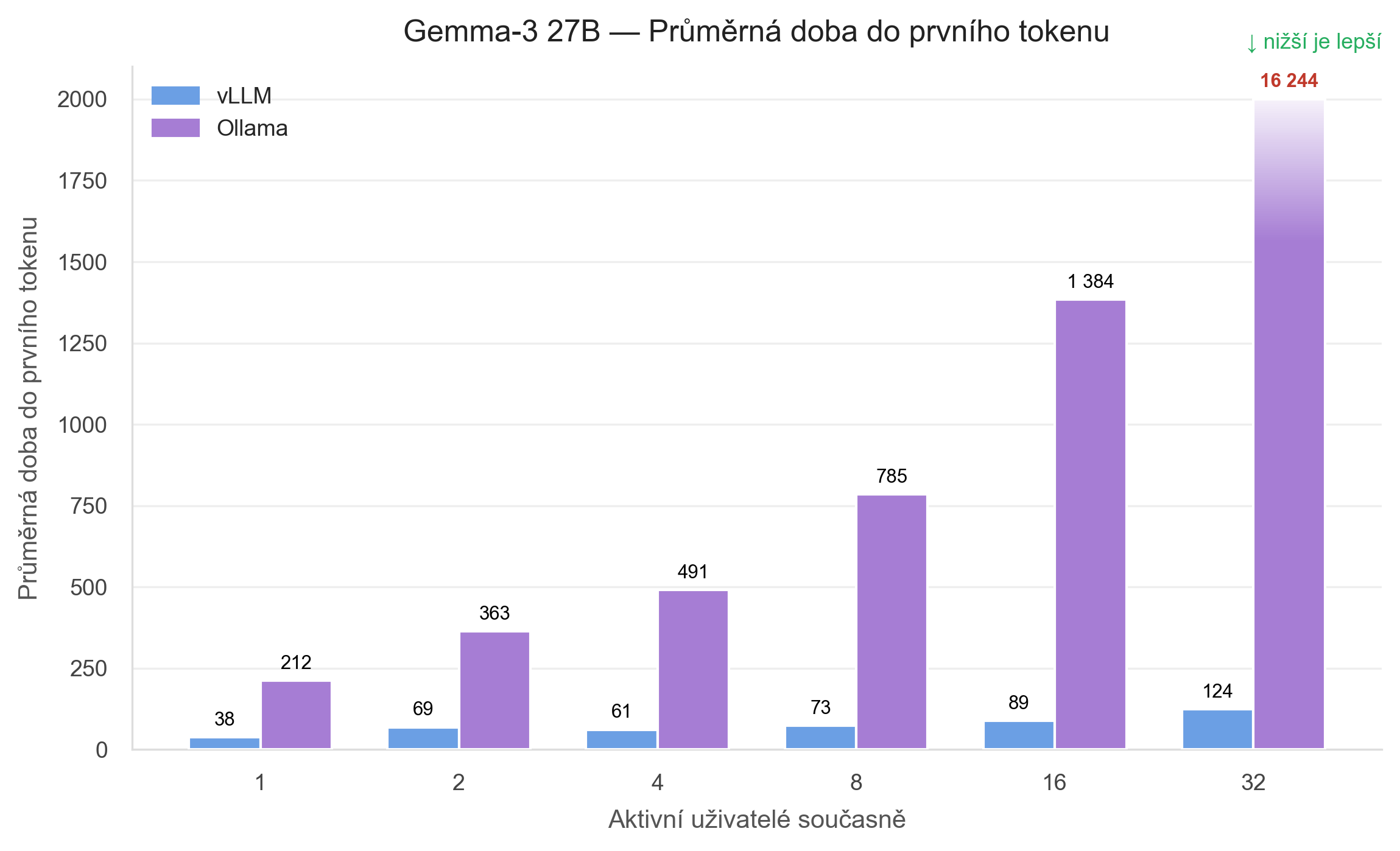

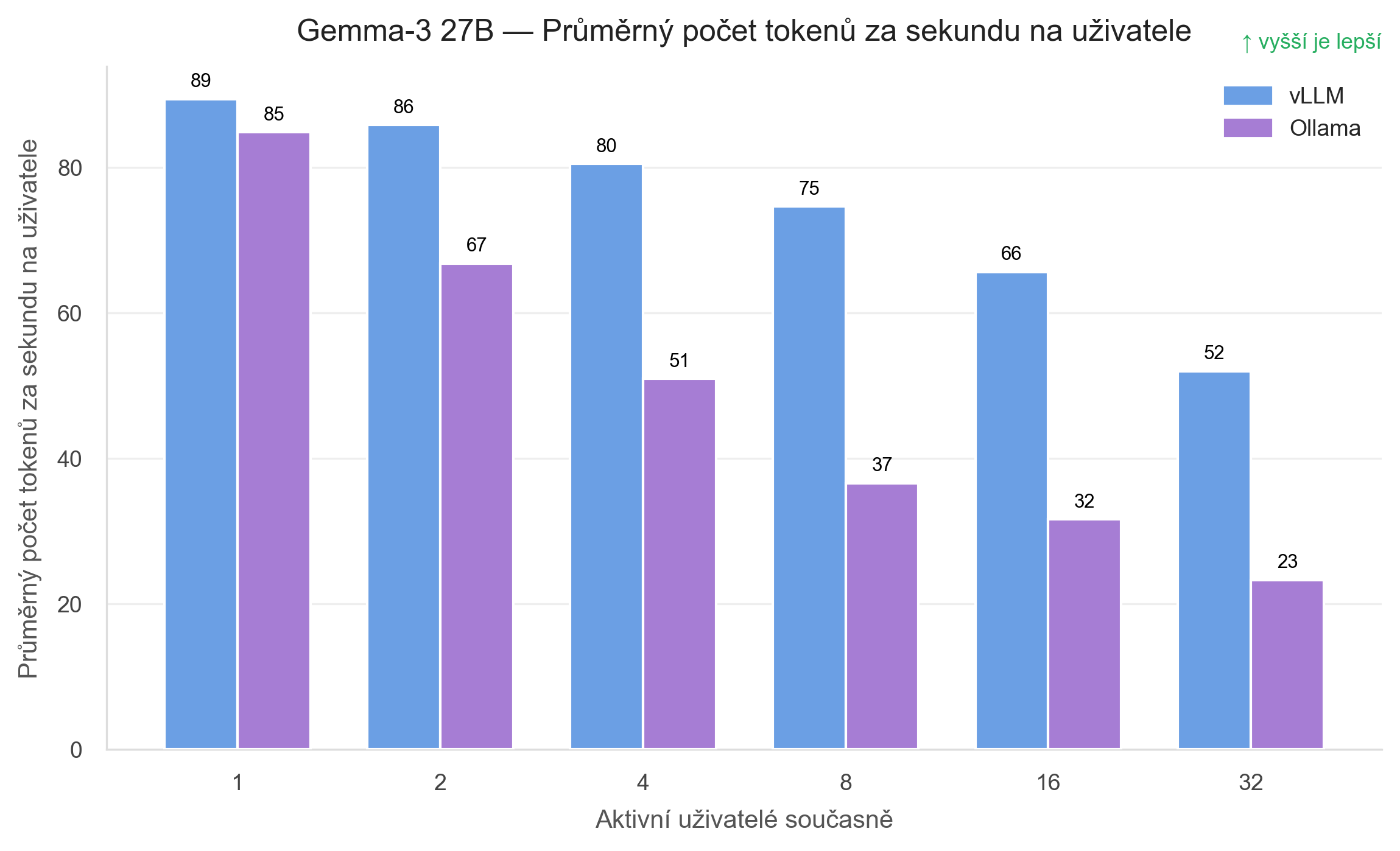

Druhý test ukazuje, že nejde jen o specifikum jednoho velkého modelu. I u Gemma 3 27B je trend velmi podobný. Menší model sice pracuje s jinými absolutními čísly, ale rozdíl v tom, jak obě platformy škálují s počtem uživatelů, zůstává stejně výrazný.

vLLM drží TTFT i tady v desítkách milisekund. Z hodnoty 38 ms při jednom uživateli roste na 124 ms při 32 uživatelích. To je nárůst, který je při běžném API použití stále velmi dobře akceptovatelný.

Ollama jde z 212 ms na extrémních 16 244 ms při 32 aktivních uživatelích. To už není jen vyšší latence, ale zcela jiná uživatelská zkušenost. Ve chvíli, kdy jeden request čeká na první token přes 16 sekund, začíná být služba pro interaktivní použití problematická.

vLLM klesá z 89 tokenů za sekundu na 52 tokenů za sekundu, což je při 32 uživatelích stále velmi solidní výsledek. Znamená to, že i při vysoké souběžnosti si každý klient udrží rozumnou rychlost generování.

Ollama spadne z 85 tokenů za sekundu na 23 tokenů za sekundu. I zde tedy platí, že s rostoucím počtem aktivních uživatelů degraduje výrazně rychleji a celkový dojem z odpovědí se zhoršuje mnohem dříve.

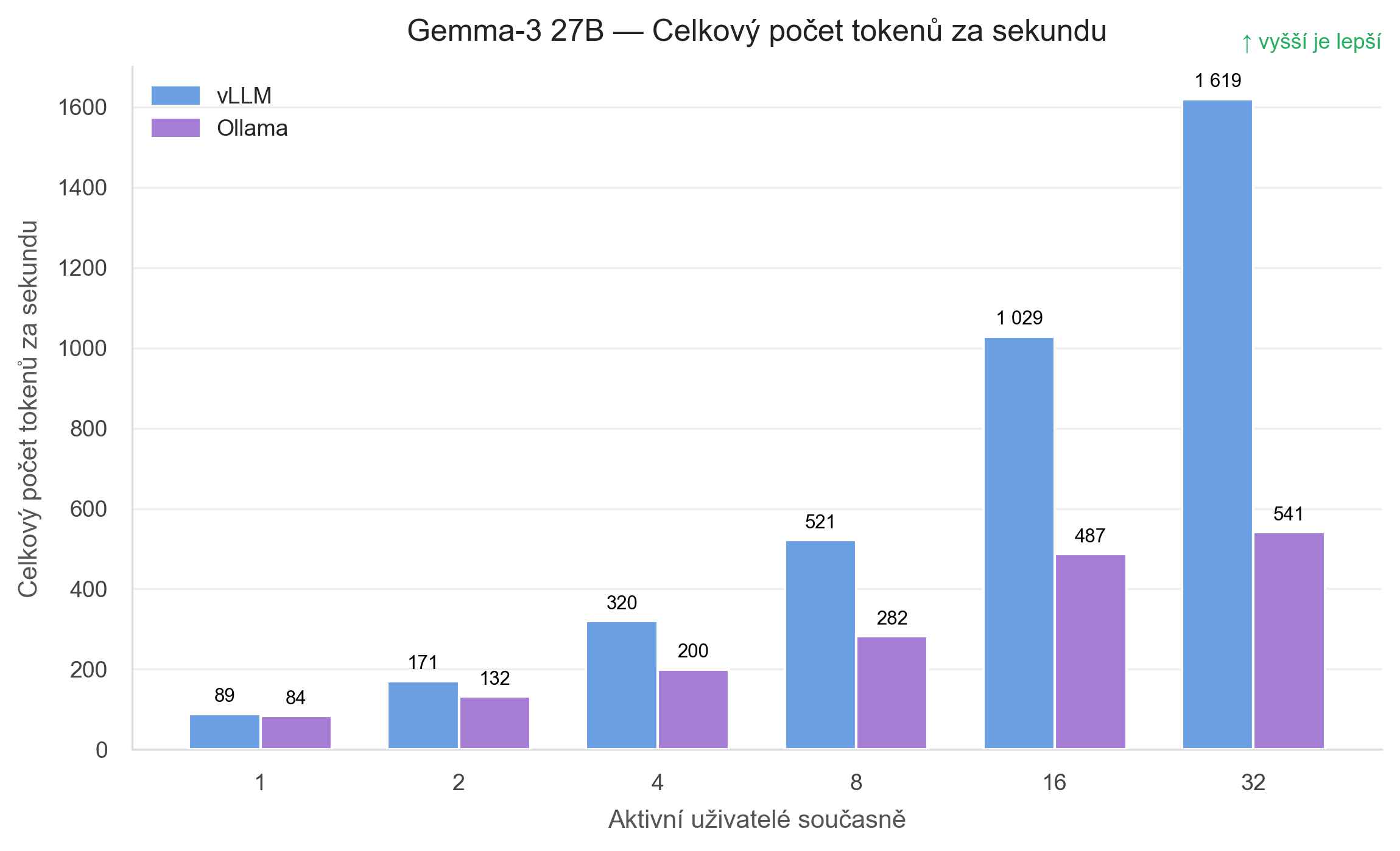

U Gemma 3 27B dochází ke stejnému efektu jako u GPT OSS 120B. vLLM roste z 89 TPS na 1 619 TPS, zatímco Ollama zůstává na 541 TPS. To znamená, že vLLM při 32 uživatelích doručuje přibližně 3× vyšší celkový výkon.

Pro praktické nasazení je to důležité zjištění: nejde jen o to, že vLLM zvládá obří modely. Stejný princip škálování funguje i u menších modelů, kde by někdo mohl čekat, že rozdíly budou menší. Nejsou.

Zjistěte na vlastních datech, jaký rozdíl udělá vLLM při vyšší zátěži a více uživatelích současně.

Naše GPU servery jsou připravené pro rychlé nasazení i reálné benchmarky.

Výsledek je konzistentní napříč oběma modely. vLLM výrazně lépe škáluje s počtem aktivních uživatelů, zatímco Ollama má při vyšší zátěži výrazně horší latenci i nižší celkový výkon.

Na GPT OSS 120B je při 32 uživatelích rozdíl zhruba 1 603 TPS vs 588 TPS. U Gemma 3 27B je to 1 619 TPS vs 541 TPS. V obou případech tedy vLLM využije jedno GPU podstatně efektivněji. Pokud provozujete interní AI endpoint, firemního asistenta nebo veřejné API, znamená to více obsloužených uživatelů na stejném hardwaru.

Stejně zásadní je rozdíl v latenci. Zatímco vLLM drží čas do prvního tokenu i při vysoké souběžnosti v desítkách nebo nižších stovkách milisekund, Ollama jde u vyšší zátěže do stovek milisekund, sekund a v některých scénářích i výrazně výš. V produkci to znamená pomalejší odezvu aplikace, horší uživatelský dojem a menší využitelnost GPU.

Hlavní důvod je architektura. vLLM používá continuous batching, efektivně plánuje requesty a dynamicky přiděluje KV cache podle skutečné potřeby jednotlivých uživatelů. Díky tomu umí držet GPU vytížené blízko maxima a zároveň dobře pracovat s více paralelními požadavky.

Ollama je navržená spíše jako pohodlný lokální runtime než jako inference engine pro vysoký paralelismus. Výhodou jsou GGUF modely a nízké nároky na hardware, ale při větším množství souběžných requestů se její architektura projeví jako limitující. Jednoduše řečeno: funguje výborně pro lokální práci, ale méně přesvědčivě pro multi-user produkci.

Pokud řešíte lokální vývoj, experimenty nebo slabší hardware, dává Ollama velmi dobrý smysl. Je rychlá na rozběhnutí, pohodlná pro prototypy a nevyžaduje tak výkonnou GPU ani robustní infrastrukturu.

Jestli ale chcete provozovat produkční API, obsloužit více aktivních uživatelů současně a využít GPU opravdu naplno, vLLM je výrazně lepší volba. Přesně v takovém scénáři se ukazuje, že rozdíl mezi jednoduchým spuštěním a skutečně efektivní inferencí je zásadní.

Ollama znamená jednoduchost, flexibilitu a nízkou vstupní bariéru. vLLM znamená výkon, škálování a výrazně lepší využití GPU.

Naměřená data ukazují, že jakmile do hry vstoupí více aktivních uživatelů současně, rozdíl mezi oběma přístupy rychle naroste. vLLM si drží nízkou latenci, výrazně vyšší celkový throughput a lépe škáluje napříč modely. Pokud tedy chcete z GPU dostat maximum a obsloužit více uživatelů současně, vLLM je jasná volba – objednejte zde.

Napište nám a připravíme vám vhodné řešení pro rychlé nasazení vLLM, velkých jazykových modelů i vlastního AI API.