Než začnete s instalací vLLM, vyplatí se vědět, proč jsou naše AI/GPU servery vhodnou platformou pro produkční inferenci, testování open-source modelů i provoz vlastního AI API.

AI/GPU server si objednáte přímo na stránce služby, kde zvolíte vhodnou konfiguraci a dokončíte objednávku. Pokud hledáte ideální řešení pro vLLM a rozsáhlejší LLM modely, doporučujeme zvolit variantu s NVIDIA RTX PRO 6000 Blackwell.

Po dokončení objednávky a úspěšné platbě obdržíte e-mail s přihlašovacími údaji. Jakmile se připojíte k serveru, můžete okamžitě začít s přípravou prostředí pro AI inference server.

Přesvědčte se sami o síle nejvýkonnějších AI GPU na trhu.

Otestujte AI VPS a plaťte až po vyzkoušení.

Každý AI/GPU server je připraven tak, abyste mohli oddělit systémové soubory od dat pro modely a cache. Systémový disk má kapacitu 150 GB, zatímco datový disk nabízí 2 TB a je připojený jako /data.

Právě do umístění /data doporučujeme ukládat virtuální prostředí, stažené modely, Hugging Face cache i další objemnější soubory. Získáte tak více prostoru pro dlouhodobý provoz a zároveň nepřetížíte systémový disk.

vLLM je výborná volba pro každého, kdo chce provozovat AI modely efektivněji, rychleji a s lepší obsluhou více požadavků najednou. Níže najdete kompletní postup, jak připravit server, nainstalovat potřebné nástroje a spustit první API endpoint pro inference.

Nejprve aktualizujte balíčky a nastavte oprávnění k datovému disku. Tím si připravíte prostředí, do kterého budete ukládat cache, virtuální prostředí i modely pro vLLM.

sudo apt update

sudo chown vpsuser:vpsuser /dataAby vLLM využilo výkon GPU naplno, je nezbytné doinstalovat aktuální NVIDIA CUDA Toolkit. Níže uvádíme příklad pro Ubuntu 24.04, ale počítejte s tím, že se instalační příkazy mohou v čase měnit podle verze systému nebo CUDA balíčků.

Pokud by některý příkaz přestal fungovat, otevřete stránku NVIDIA CUDA Downloads a vygenerujte si aktuální postup pro vaši konfiguraci systému.

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2404/x86_64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get -y install cuda-toolkit-13-2Následně vytvoříme samostatné Python virtuální prostředí na datovém disku. Díky tomu zůstane instalace přehledná, snadno přenosná a nebude zbytečně zatěžovat systémovou část serveru.

sudo apt install -y python3-pip python3.12-venv

python3 -m venv /data/vllm-py

source /data/vllm-py/bin/activate

pip install vllmPo dokončení instalace budete mít připravené prostředí pro spuštění vLLM serveru i dalších knihoven podle potřeby.

Před samotným spuštěním doporučujeme nastavit cache pro Hugging Face modely na datový disk. Zabráníte tím plnění systémového úložiště a zároveň budete mít všechny velké soubory přehledně uložené na jednom místě.

API klíč si můžete jednoduše vygenerovat pomocí tr -dc 'A-Za-z0-9' </dev/urandom | head -c 32; echo a následně ho vložit do příkazu místo VYGENERUJTE-SI-KLIC-A-VYMENTE.

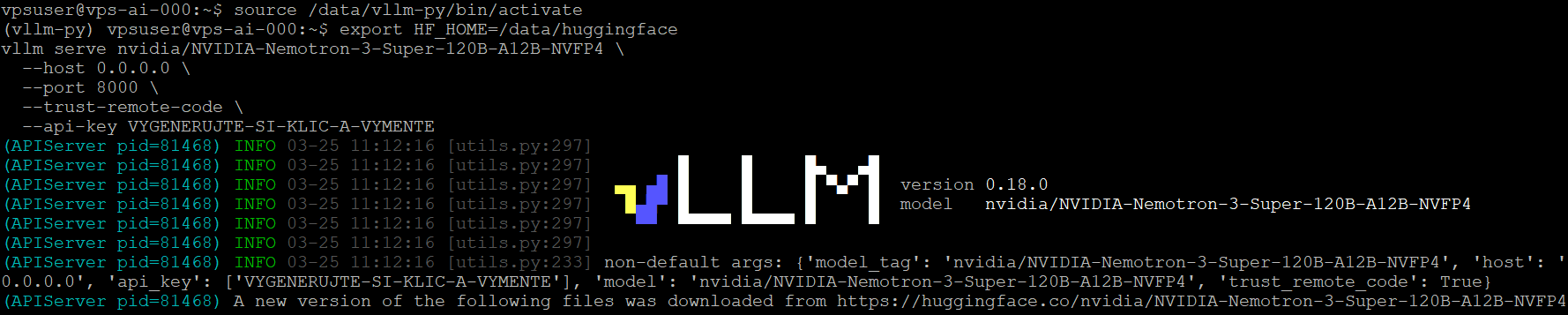

Níže uvedený příklad spouští model NVIDIA Nemotron 120B, který dobře ukazuje, jaký potenciál mají servery s 96 GB VRAM a profesionální Blackwell grafikou pro rozsáhlejší inference workloady.

export HF_HOME=/data/huggingface

vllm serve nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4 \

--host 0.0.0.0 \

--port 8000 \

--trust-remote-code \

--api-key VYGENERUJTE-SI-KLIC-A-VYMENTEPo spuštění začne vLLM připravovat model pro inference. Doba prvního načtení závisí na konkrétním modelu a může trvat až několik minut.

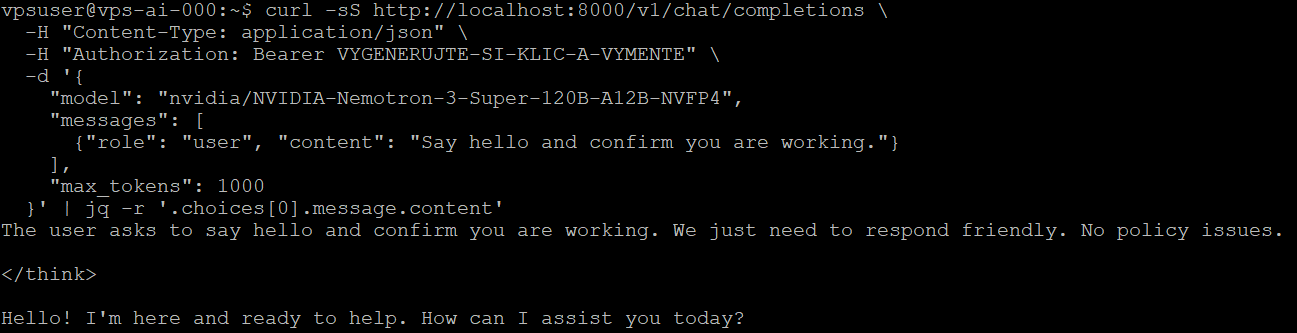

Jakmile vLLM běží, otevřete si druhou konzoli a proveďte test API. V ukázce níže nahraďte hodnotu VYGENERUJTE-SI-KLIC-A-VYMENTE vlastním klíčem, který jste nastavili v předchozím kroku.

Při prvním požadavku počítejte s tím, že model může přibližně 10 sekund inicializovat odpověď. Další requesty už bývají rychlejší a čas zabere převážně samotné generování výstupu.

curl -sS http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer VYGENERUJTE-SI-KLIC-A-VYMENTE" \

-d '{

"model": "nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4",

"messages": [

{"role": "user", "content": "Say hello and confirm you are working."}

],

"max_tokens": 1000

}' | jq -r '.choices[0].message.content'Pokud se vrátí textová odpověď modelu, máte hotovo a váš vLLM inference server je připravený pro další integraci, automatizaci i napojení na vlastní aplikace.

AI/GPU server s výkonnou grafikou nevyužijete jen pro jeden konkrétní model. Jakmile máte připravené vLLM nebo jiné inference prostředí, můžete server nasadit i pro další AI scénáře a firemní use-case.

Díky této flexibilitě získáte univerzální GPU infrastrukturu, kterou snadno přizpůsobíte vývoji, testování i produkčnímu provozu.

AI/GPU server s NVIDIA RTX PRO 6000 Blackwell představuje rychlé a praktické řešení pro každého, kdo chce rozběhnout vLLM, provozovat vlastní inference endpoint a využít vysoký výkon GPU bez pořizování drahého fyzického hardware.

Napište nám a připravíme vám vhodné řešení pro rychlé nasazení vLLM, velkých jazykových modelů i vlastního AI API.